Эффективность RAG достигается системной оценкой компонентов и предобработкой

Пути к улучшению

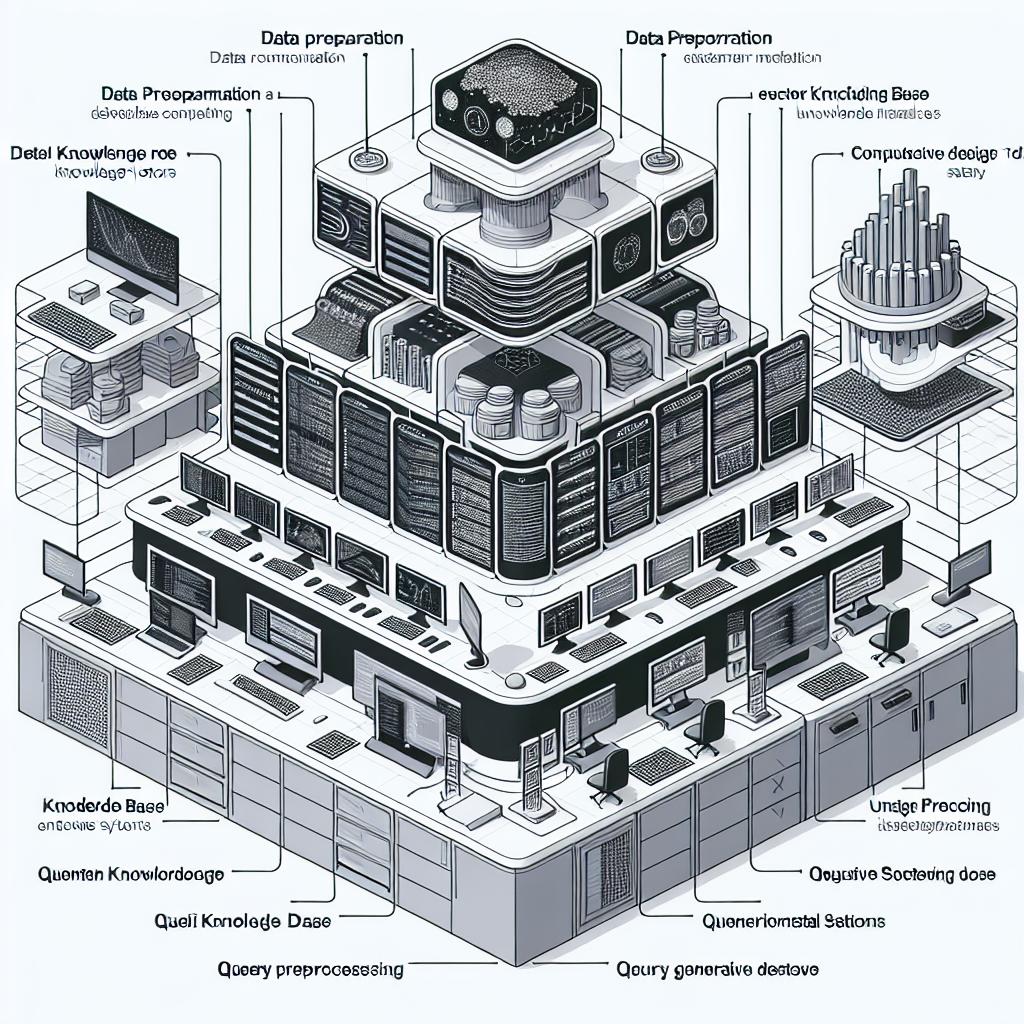

Эффективность RAG (Retrieval-Augmented Generation) достигается не только за счёт улучшения генератора, но и через системную оценку всех компонентов и продуманную предобработку данных. На пути к улучшению выделяют пять подсистем:

- 1) предварительная обработка данных — структурирование источников, разбиение документов на логические чанки и сохранение привязки к исходному документу;

- 2) энкодер — качество векторизации чанков и запросов, скорость;

- 3) векторная база знаний — поиск, масштабируемость и потребление памяти;

- 4) подсистема предобработки запросов — насыщение контекстом истории чата и разбиение запроса на подзадачи;

- 5) генеративная модель — синтез ответа с учётом найденной информации.

Оценку рекомендуется проводить по каждой компоненте: метрики Precision/Recall/F1/NDCG для векторизации, показатели latency и memory для базы, подход “LLM-as-judge” для предобработки запросов, а финальный ответ — вручную или через готовые наборы тестов. Такой подход снижает риск противоречий в знаниях и поддерживает многошаговую логику диалога, что提升ает точность и надёжность всей RAG-системы.

Оценка RAG

Оценка RAG традиционно строится вокруг тройной цели: контекстная релевантность фрагментов, фактологическая точность ответа и релевантность финального решения запроса. Но такой подход не учитывает логику диалоговой системы и длинный контекст чатов. В реальном использовании важны этапы и их взаимодействие: от предобработки данных и разбиения документов до того, как запрос преобразуется в подзадачи, как чанки кодируются и как запрос проецируется в векторное пространство, как управляется векторная база и как синтезируется ответ с учётом найденного контекста.

Эта схема требует оценки не только качества итогового текста, но и каждого компонента и их взаимодейства: подсистема предварительной обработки данных, энкодер, векторная база, подсистема предобработки запросов и генеративная модель. Метрики применяют на разных уровнях: для энкодера — Precision@K, Recall@K, F1, mAP и NDCG; для предобработки запросов — качественные оценки или режимы типа LLM-as-judge; для векторной базы — время поиска, пропускная способность, потребление памяти; для генерации — BLEU/ROUGE/METEOR и экспертная оценка. Важно видеть не столько итоговый текст, сколько качество взаимодействия между подсистемами.

Что обычно упускается

Чаще всего упускается то, что для диалоговой системы важны нюансы, выходящие за рамки «поиск — запрос — генерация». Без учета истории беседы и целей пользователя итоговый ответ может противоречить предыдущим сообщениям или потребовать лишних уточнений. Например, в разговоре про оформление отпуска модель должна помнить, что инциденты и отпуск взаимосвязаны: уведомления коллег зависят от контекста прошлых обращений. Аналогично предобработка документов требует не только разбиения на чанки, но и явной привязки каждого чанка к конкретному источнику и разделу, чтобы не перепутать данные (например, мозг человека и мозг обезьяны).

Кроме того, критически важна настройка взаимодействия между компонентами: подсистема подготовки данных (структурирование и разбиение), энкодер, векторная база, предобработка запросов и генеративная модель. Их баланс определяет качество диалога: от точности извлечения до когерентности и последовательности рассуждений. Упущенные нюансы ведут к потере контекстной целостности, противоречиям между ответами и снижению доверия пользователя.

Компоновка компонентов RAG

Компоновка компонентов RAG представляет собой взаимосвязанную цепочку: подсистема предварительной обработки данных структурирует источники и разбивает их на логические фрагменты, сохраняя контекст; энкодерная модель векторизует как чанки, так и запрос пользователя; векторная база знаний хранит эмбеддинги и обеспечивает быстрый поиск релевантных фрагментов; подсистема предобработки запросов обогащает запрос контекстом истории чата и может разбивать задачу на подзадачи; генеративная модель синтезирует финальный ответ, опираясь на найденные фрагменты и контекст. Важна согласованность между компонентами: единый формат данных, ясная привязка чанков к исходному документу, учет истории во время поиска и избегание противоречий между источниками.

Схема RAG и оценка

Схема RAG и её оценка предполагают не только проверку финального вывода, но и всестороннюю валидацию каждого элемента конвейера: подготовки данных, энкодера, векторной базы, предобработки запросов и генеративной модели. Для подготовки данных оценивают, насколько корректно разбиты документы и сохранён контекст; для энкодера — качество векторизации и ранжирования релевантности (Precision@K, Recall@K, F1, mAP, NDCG); для векторной базы — время поиска, пропускную способность и потребление памяти; для предобработки запросов — способность дополнять запрос контекстом истории и корректно распадать его на подзадачи; для генератора — соответствие и качество синтеза, часто через BLEU/ROUGE/METEOR или экспертную оценку. Такой подход позволяет выявлять узкие места, учитывать диалоговую историю и снижать риск противоречий между фрагментами знаний, а результаты оценки — подспорье для дообучения конвейера.

Оценка предобработки

Первый компонент RAG-процесса — подсистема предобработки данных — оценивается по качеству разбиения документов на логически целостные фрагменты и сохранению смысла исходной информации. Чётких числовых метрик здесь часто не задают; важнее способность структурировать данные так, чтобы фрагменты были достаточно автономны, но при этом сохраняли контекст и взаимосвязи. Баланс между размером фрагмента и полнотой смысла — ключевой критерий: слишком мелкие куски теряют контекст, слишком крупные затрудняют поиск и генерацию.

В простейшем практическом варианте целесообразна конвертация источников в унифицированный текстовый формат, например markdown, потому что большинство генеративных моделей комфортно обрабатывают именно этот формат. Далее выполняется разбиение по заголовкам, что позволяет точно воспроизводить структуру источника и избегать перекрещивания фактов между разделами. Такой подход упрощает последующую векторизацию и поиск, снижает риск потери контекста и улучшает точность ответов.

Оценка энкодерной модели

При оценке энкодерной модели важны не только качество векторизации чанков и запросов, но и вычислительная эффективность самой модели. Для семантического представления применяют метрики Precision@K, Recall@K, F1-score@K и mAP, которые позволяют оценить качество ранжирования релевантных результатов на разных порогах. Дополнительно включают NDCG, учитывающий позиции релевантных объектов и вес их значимости, что особенно важно для последующей генерации ответа. Значения метрик лежат в диапазоне [0,1], где 1 — идеал. Выбор метрик чаще всего ориентируется на сводную таблицу потребностей системы и качества ранжирования: топ-K точности при быстром доступе или полноту при всестороннем поиске. В качестве упрощения можно опираться на существующие бенчмарки вроде encodechka, но адаптация к специфике данных требует подготовки собственного набора данных и, возможно, скорректированных весов значимости релевантности.

Оценка векторной базы данных

Оценка векторной базы данных ориентируется не только на качество поиска, но и на эксплуатационную производительность инфраструктуры. Ключевые метрики — время одного поиска, пропускная способность системы при заданном потоке запросов и потребление памяти в конкретной среде исполнения. В рамках тестирования учитывают аппаратное окружение (CPU/GPU, объем оперативной памяти, скорость дисков, сетевые задержки) и параметры конфигурации. Рекомендовано пользоваться готовыми бенчмарками, к примеру Zilliz Cloud, чтобы сравнивать решения и формировать план масштабирования. Особое внимание уделяют горизонтальному росту: как изменяются задержки и пропускная способность по мере увеличения объема данных и числа запросов, какие узкие места возникают и какие методы сжатия или индексы улучшают ситуацию.

Оценка предобработки запросов

Автоматизация оценки предобработки запросов возможна через подход «LLM-as-judge»: языковая модель выступает в роли эксперта, оценивая качество ответа и эмулируя человеческую экспертизу, чтобы снизить ручной труд. Примеры реализации — Alpaca Eval и близкие фреймворки. Такой подход позволяет быстро тестировать, как входной запрос обогащается контекстом из истории чата, инструкций пользователя или разбиения на подзадачи, и как эти изменения влияют на итоговую релевантность.

Суть в том, что LLM-«судья» получает на вход исходный запрос, дополненный контекстом, и сгенерированный системой ответ, после чего выдает оценки и комментарии — что в ответе хорошо, а какие моменты требуют доработки. Это позволяет сравнивать разные стратегии предобработки и оперативно настраивать пайплайн для повышения релевантности и устойчивости к контексту.

Оценка синтезированного ответа

Финальную оценку синтезированного вывода чаще выполняют эксперты, но её можно автоматизировать через заранее подготовленные ответы и модели-judge, которые ставят баллы за соответствие. Для сравнения применяют BLEU, ROUGE и METEOR — метрики, отражающие перекрытие форм и смысловую близость между сгенерированным текстом и эталоном. Однако их настройка требует аккуратности: веса релевантности, учёт длины и качество аннотаций влияют на результаты, и сами метрики не дают полного охвата смысла и не проверяют фактическую точность вывода.

В сложных задачах креативность и точность могут уходить за рамки того, что фиксирует поверхностное соответствие. Поэтому важно сочетать автоматизированные оценки с экспертной оценкой и дополнительными методами: проверкой фактов, анализом логики вывода, оценкой полноты и применимости вывода к задаче.

Заключение

Наивная реализация RAG часто ограничена невысокой релевантностью и качеством предобработки. Главная идея — перейти от узкого подхода «запрос — поиск — ответ» к системной доработке компонентов: структурирование данных и их разделение на логически обоснованные фрагменты; расширение контекстов за счёт истории чата и связанных документов; точная маркировка источников и принадлежности чанков; продуманная векторная архитектура, обеспечивающая устойчивость к изменениям данных; многошаговый синтез ответа, учитывающий логику рассуждений и зависимости между данными. Внедрение таких подходов открывает новые возможности для интеллектуальных диалоговых систем, аналитических сервисов и бизнес-приложений, повышая точность, согласованность и актуальность выдачи.